AIを導入したのに、なぜ仕事は速くならなかったのか。

生成AIの業務活用は、この数年で急速に広がりました。メールの下書き、資料の要約、議事録の整理——個々のタスクは確かに速くなっています。

しかし、AIチャットの体験は「人間がAIの返答を待ってから、次を考える」という往復構造に縛られています。問いかけ、待ち、読み、また問う。この構造のもとでは、AIを使えば使うほど、人間側の思考は寸断されていきます。

世界ではすでに、AIエージェントへの移行が潮流となりつつあります。開発者や個人利用者の領域では、実用段階に入り始めました。一方で日本の法人現場には、プロダクト単体では解けない要件が残っています。自社の基幹システムとの連携。現場への定着支援。機密情報のガバナンス。——このどれが欠けても、AIは業務の中心には据えられません。

Bestllamは、この差分を埋めるために設計されています。

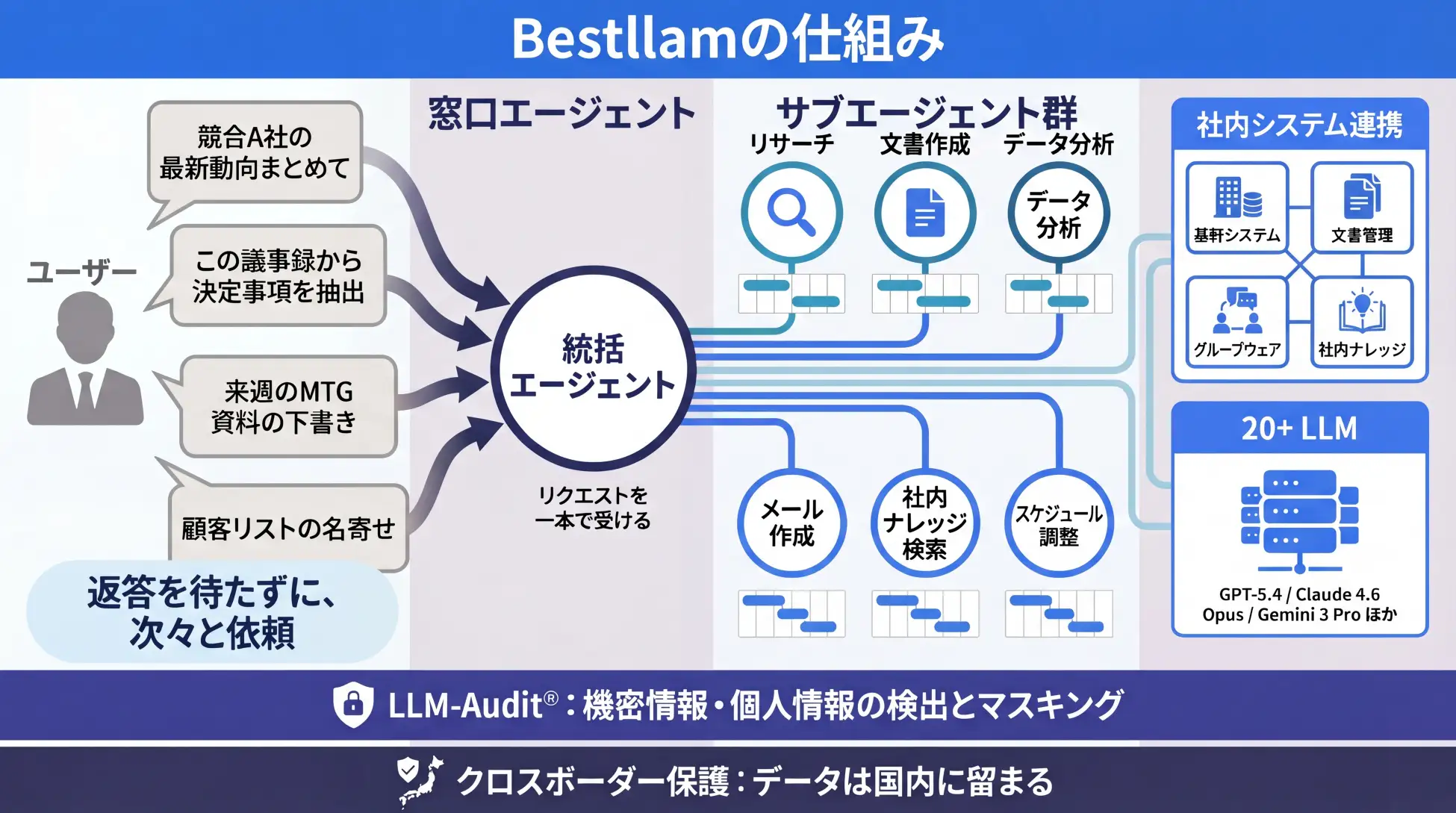

窓口は一本。裏には複数のサブエージェント。

思考を止めずに、次々と依頼できる。

図:Bestllam AIエージェントの全体構造。窓口エージェントが複数のサブエージェントを並列にオーケストレーションし、社内システムおよび20以上のLLMと接続。LLM-Audit®とクロスボーダー保護が全体を支える。

3つの価値

託せる

頼んでおけば、仕事は終わっている

ユーザーは依頼を投げるだけ。背後ではサブエージェント群が非同期に動き、リサーチ、資料作成、データ整理、メール下書き、社内ナレッジ検索といった複数の業務が並行で進んでいきます。

たとえば「議事録から決定事項を抽出して、関係者へ共有」と伝えれば、抽出・整形・宛先選定・送信文面作成までを一本の依頼で完了させられます。一問一答の往復ではなく、依頼したときには、もう仕事の大部分が片づいている状態です。

止めない

返事を待たず、次の依頼を重ねていい

窓口エージェントがリクエストを一本で受け、背後の複数のサブエージェントが並列に処理を進めます。ユーザーは前の処理の完了を待つ必要がなく、思いついた順に指示を重ねられます。

Bestllamがこれまで培ってきた「複数LLMの同時稼働」という並列処理アーキテクチャを、エージェント実行基盤へ拡張したものです。技術的な裏付けは次のセクションで説明します。

守れる

自律するAIに、ガバナンスを

LLM-Audit®が、入出力の双方で機密情報・個人情報を検出・マスキング。クロスボーダー保護オプションにより、データを国外に出さない運用も選べます。

官公庁・自治体・大企業の決裁に通せるエンタープライズガバナンスを標準で備え、自律性と統制を両立させます。

実際の動きを、3分で。

窓口エージェントが依頼を受け、サブエージェントが裏で片づけていく様子をご覧ください。

仕組み ― なぜこれが可能なのか

エージェント型UXは、理屈では語れます。しかし実装するには、並列実行基盤、社内データ接続、安全な実行環境、業務知識の蓄積、これらすべてが揃っている必要があります。Bestllamには、その全てが最初から入っています。

01並列実行基盤

複数LLMを同時に稼働させるアーキテクチャを、そのままエージェント実行基盤へ拡張。Bestllamが元々持っていた「6 LLM同時稼働」の思想が、マルチエージェントの並列処理へ接続されています。返答を待たずに次の依頼を重ねられるのは、この基盤が背後で動いているからです。

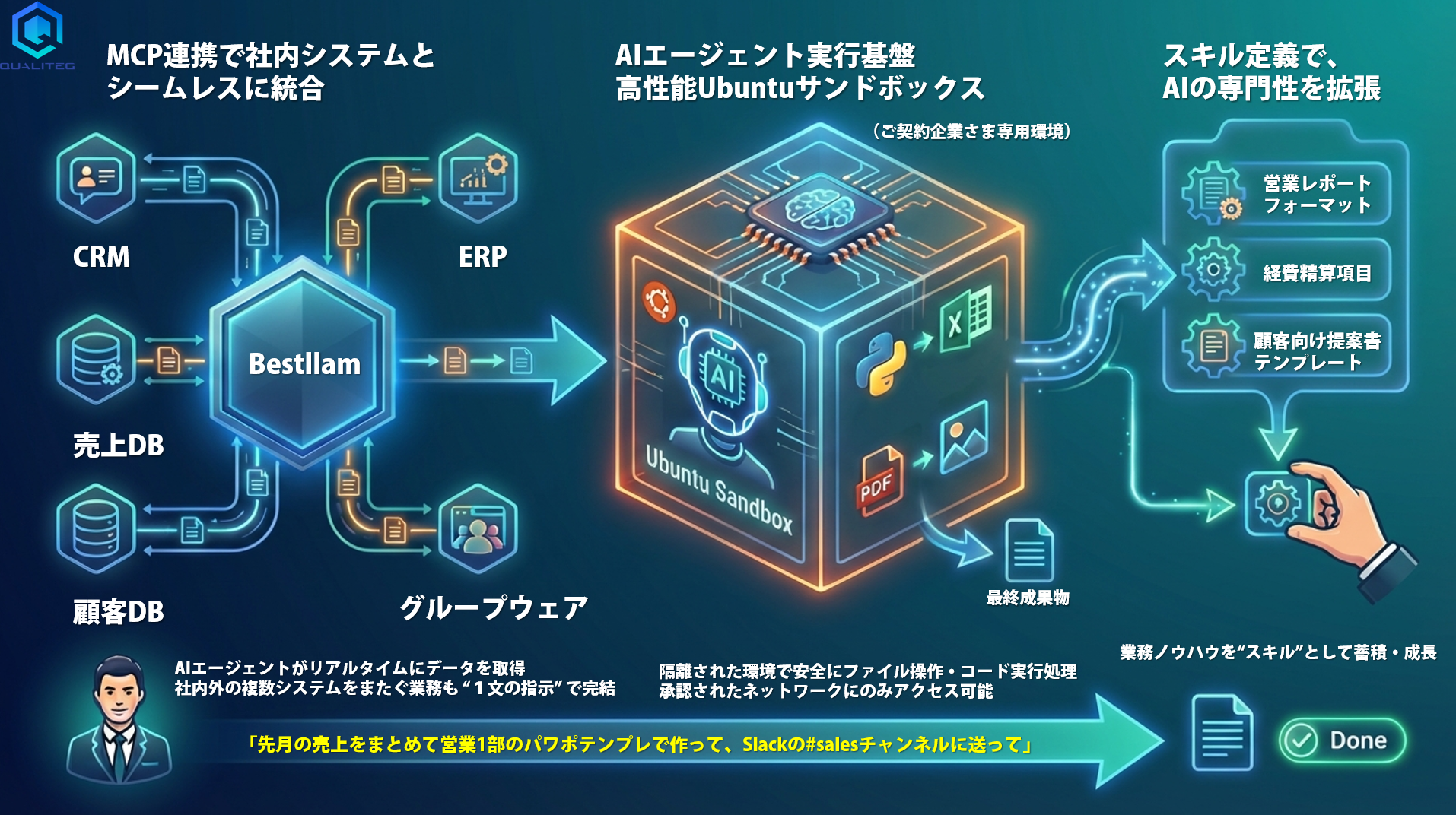

02MCP連携

MCP(Model Context Protocol)により、CRM、ERP、データベース、グループウェアといった社内システムにエージェントを接続。エージェントはリアルタイムにデータを取得・更新し、複数システムをまたぐ業務も一本の依頼で完結させます※。

03Ubuntuサンドボックス

企業専用の隔離実行環境。Pythonスクリプトの実行、Excel/PowerPoint/PDFの生成・加工、画像処理まで、エージェントがファイル操作を直接こなします。MCPで取得したデータを、サンドボックス内で自在に加工し、最終成果物まで生成します。

Bestllamの立ち位置

エージェント型UXの方向性は、グローバルで共有された開発テーマです。そのうえでBestllamが担うのは、日本企業が実際に業務で使えるかたちに仕立てるという役割です。

社内システムとの連携

基幹システム、文書管理、グループウェア、社内ナレッジベースなど、法人の内側にある情報資産にエージェントを接続します。汎用AIが「外から見える情報」で動く段階を超え、社内の文脈に根ざした業務遂行が可能になります。

導入から定着までの伴走

Qualitegのコンサルティングチームが、PoCから運用設計、現場トレーニング、業務プロセス再設計までを一貫して支援します。ツールを導入して終わりではなく、業務の中で使われ続ける状態まで責任を持ちます。

20以上のLLMを、単一契約で

GPT-5.4、Claude 4.6 Opus、Gemini 3 Proなどの主要モデルを統合提供。タスクに応じた自動選択と、最大6モデルの同時稼働による精度向上を、契約一本で利用できます。

グローバルなAIプラットフォーマーが提供するのは、プロダクトそのものです。法人導入の現場で最後の一歩を埋めるのは、国内の業務文脈を理解し、システム連携と定着まで責任を持つパートナーです。Bestllamは、その役割を担います。

20+のLLM。契約は一本。

エージェントはタスクに最適なモデルを自動選択。主力のGPT-5.4、Claude 4.6 Opus、Gemini 3 Proをはじめ、

高速モデルからオープンソースまで、業務特性に応じて最適なモデルを使い分けます。

| 提供元 | モデル名 |

|---|---|

| OpenAI | GPT-5.4 |

| GPT-5.4 Pro | |

| GPT-4o 等 | |

| Anthropic | Claude 4.6 Opus |

| Claude 4.5 Sonnet | |

| Claude 4.5 Haiku | |

| Gemini 3 Pro | |

| Gemini 3 Pro Image (Nano Banana Pro) | |

| Gemini 2.5 Pro | |

| Gemini 2.5 Flash | |

| Gemini 2.5 Flash-Image (nano banana) | |

| Gemini 2.5 Flash-Lite | |

| xAI | Grok-4 |

| Grok-4-1-fast-reasoning | |

オープンソースLLM(ローカル実行可能)※ セキュリティが重視される企業・官公庁などでは、自社内のオンプレミスサーバーでBestllamを実行可能。データを一切社外に送信することなく、業務遂行ができます。 | |

| Alibaba | Qwen3-235B-A22B-Thinking |

| Qwen3-235B-A22B | |

| Qwen3-Next-80B-A3B-Thinking | |

| Qwen3-Next-80B-A3B-Instruct | |

| Qwen3-VL-32B-Thinking | |

| Qwen3-32B | |

| Qwen3-30B-A3B-Thinking | |

| Qwen3-30B-A3B | |

| QwQ-32B | |

| Qwen3-14B | |

| Qwen3-8B | |

| Qwen3-4B | |

| DeepSeek | DeepSeek-V3.2 Thinking |

| DeepSeek-R1 | |

| DeepSeek-V3.2 | |

| Zhipu AI | GLM-4.6-FP8 |

| GLM-4.5-Air | |

| MiniMax | MiniMax-M2 |

| OpenAI | gpt-oss-120b |

| Gemma 3 27B | |

| Meta | Llama 4 |

| Mistral AI | Mistral Small |

| その他多数のオープンソースLLMに対応 | |

セキュリティ ― LLM-Audit®× クロスボーダー保護

自律的に動くAIに、企業の決裁を通せるガバナンスを。機密性の高い情報を扱う公共機関でも、データを国外に出すことなく最新のLLMを活用できます。

データ保護

- 日本国内データセンター(東京/大阪)

- オンプレミス環境オプション

- 完全クローズド環境での運用対応

- クロスボーダー保護:データを国外に出さない

LLM-Audit®による入出力監査

- PII/機密情報の検出とマスキング

- 有害コンテンツのフィルタリング

- プロンプトインジェクション/ジェイルブレイク検出

- ハルシネーション抑止

認証・アクセス管理

- OpenID Connect対応

- SSO(Google/GitHub/Microsoft)

- SAMLエンタープライズSSO(オプション)

- 多要素認証/詳細な権限管理

モニタリング

- 利用傾向レポート

- 使用量のリアルタイム可視化

- 不正アクセスの監視・通知

- セキュリティログの保管と分析

導入・サポート

導入支援

- 初期設定

- システム連携

- 運用設計コンサルティング

- セキュリティ設定

トレーニング

- 管理者向けトレーニング

- エンドユーザー向けトレーニング

- 開発者向けハンズオン

- 定期スキルアップセミナー

継続サポート

- 24時間365日テクニカルサポート

- 定期的な運用レビュー

- アップデート情報の提供

- ベストプラクティスの共有

料金体系

- スタータープラン:従量課金

- ビジネスプラン:定額制+従量課金

- エンタープライズプラン:カスタマイズ可能

- 年間一括支払による割引制度あり

Bestllamが選ばれる理由

エージェント時代に必要な機能を、一つの基盤でまとめて。

窓口×サブエージェント並列

窓口エージェントが依頼を一本で受け、複数のサブエージェントが並列で業務を処理。返事を待たずに次の依頼を重ねられます。

Ubuntuサンドボックス

企業専用の隔離実行環境。Python実行、Excel/PowerPoint/PDF生成、画像処理までエージェントが直接こなします。

スキル定義

御社固有の業務ノウハウをスキルとして定義。エージェントは御社専属のエキスパートへと育っていきます。

LLM-Audit®入出力監査

入力・出力の双方で機密情報/PIIを検出・マスキング。プロンプトインジェクションやジェイルブレイクも検出します。

クロスボーダー保護

データを国外に出さない運用が可能。官公庁・自治体・金融など、越境制約のある領域でも安心して導入できます。

契約の一本化

LLMプロバイダごとの契約処理が不要。Bestllamとの契約だけで20以上のLLMを利用可能です。

常に最新のモデル

GPT-5.4、Claude 4.6 Opus、Gemini 3 Proなど、最新LLMが公開され次第、速やかに利用可能に。

6 LLM同時稼働

複数のLLMに同時に質問し、回答を比較。重要な意思決定で最適な答えを選べます。

マルチモーダル対応

画像・PDF・Office文書のアップロード分析に対応。文書分析や画像認識も統合UIで実行できます。

MCP連携

CRM/ERP/DB/グループウェアなど、既存の業務システムに接続。AI対話で業務を一本化します。

国内DC/オンプレミス

日本国内データセンターまたはオンプレミス環境で運用可能。完全クローズド環境にも対応します。

画像生成対応

Nano Banana Proなど最新の画像生成AIに対応。テキストから高品質な画像を生成できます。

柔軟な認証

OpenID Connect/Google・GitHub・Microsoft SSO/SAMLに対応。既存の認証基盤と統合可能。

利用傾向レポート

従業員のLLM利用状況を分析・可視化。効果測定やセキュリティポリシーの最適化に活用できます。

使用量の可視化

トークン使用量をリアルタイムで確認。部門別・プロジェクト別のコスト管理が可能です。

法人向け定額/従量

従量課金制と定額制を併用可能。予算管理がしやすく、安心してご利用いただけます。

ワーキングセット

翻訳・要約・財務分析・コーディングなど、用途別に最適化された動作を実現できます。

テンプレート機能

よく使う操作をテンプレート化。ワンクリックで呼び出し、業務効率を大幅に向上させます。

AI・NLP専門家による開発

GPU推論サーバーを自社保有し、LLM・自然言語処理の専門家集団が開発。深い技術力に裏打ちされています。

導入後の伴走支援

Qualitegのコンサルティングチームが、PoCから運用設計、現場定着まで一貫して伴走します。